站群多ip服务器台湾与CDN结合提高搜索引擎收录效率

本文总结了通过在台湾区域部署多ip服务器并与CDN结合,提升站群整体收录效率的核心策略:合理分散IP与机房、优化爬取策略与速度、做好内容去重与站点关联管控、并通过CDN加速与缓存策略降低响应时间,从而提高搜索引擎友好度与索引率。

哪里适合部署多ip服务器与CDN以提高收录率?

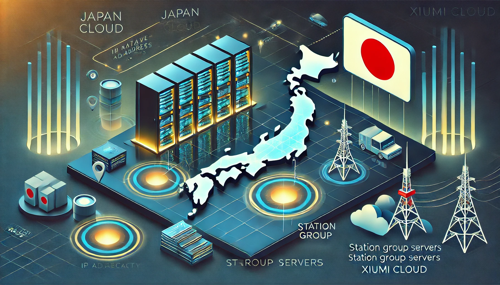

对于面向台湾用户或希望在华语市场内获得更好本地排名的站群,优先选择台湾本地或近邻地区的机房节点能显著降低延迟并提升响应速度。将源站放在台湾机房,同时借助全球或区域性CDN的边缘节点(含台港日等)可兼顾本地访问体验与全球可达性。关键是保证DNS解析稳定与TTL设置合理,避免因解析波动影响爬虫抓取。

多少个IP对站群的收录更有帮助?

没有固定魔法数字,但原则是“合理分散、避免过度集中”。建议每个站群站点使用独立IP或小批量共享IP,整套站群保持数十至数百个IP分布在不同机房与运营商之间,能降低单点被惩罚的风险,提高不同站点被独立识别与抓取的概率。切忌大量短时间内频繁更换IP,以免触发搜索引擎的可疑行为检测。

哪个托管或CDN方案更适合面向台湾的站群?

优先选择在台湾或附近有PoP(Point of Presence)的云服务商或CDN供应商,以保证节点覆盖与网络质量。对比时关注:节点分布、回源带宽、缓存控制能力、TLS/HTTP2支持、日志与分析能力。对于高并发与真实性验证需求,混合使用公网云主机和专线回源的CDN能兼顾性能与稳定性。

如何结合台湾多ip服务器与CDN来优化收录效率?

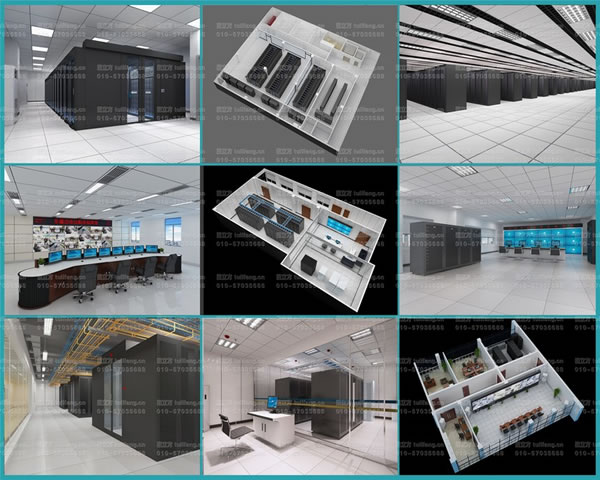

实操上建议按以下步骤:1)源站部署在稳定的台湾机房并启用SSL;2)为站群配置多IP策略,IP分配与WHOIS信息保持合理差异;3)通过CDN做静态资源与页面缓存,设置合适的Cache-Control与Stale-While-Revalidate策略,降低回源压力;4)为关键页面开放爬虫友好的缓存TTL与IP白名单,避免因CDN缓存导致爬虫抓取延迟;5)保持站点速度、移动适配与结构化数据完整,提高抓取优先级。

为什么要重视内容去重与站群之间的关联管理?

搜索引擎更倾向于索引具有独立价值的页面。若站群内大量模板化或重复内容,会导致抓取预算浪费与收录率下降。通过统一的canonical、凌驾sitemap优先级的配置、并为每个站点提供原创内容或独特化页面,同时用robots合理屏蔽低价值页,可以显著提升有效收录比率,并减少因相似性被判为低质的风险。

怎么监控与持续优化站群的收录表现?

监控维度包括:抓取频次与错误(通过Search Console与Bing Webmaster)、日志分析(爬虫IP与响应时间)、页面速度与Core Web Vitals、CDN命中率与回源带宽、以及索引量与流量变化。定期检查robots、sitemap与canonical配置,结合A/B测试调整缓存策略和页面结构。对于异常收录下滑,应第一时间核查IP是否被封、内容策略是否被改动或服务器是否存在长期错误。

-

台湾站群推广优化系统:提升SEO效果的利器

在当今竞争激烈的互联网市场中,网站主们对于提升自己网站的搜索引擎优化(SEO)效果越来越重视。而台湾站群推广优化系统成为了一种强大的工具,帮助网站主们提升他们的SEO效果,并取得更好的搜索结果排名。 台湾站群推广优化系统是一种集成了多种功能的软件系统,旨在帮助网站主们优化他们的网站,提升搜索引擎排名。 功能一:站点管理 台湾站群推广优化2025年1月12日 -

台湾站群VPS如何提升虾皮店群的运营效率

提升虾皮店群运营效率的最佳选择 在当今电商竞争日益激烈的市场环境中,如何提升虾皮店群的运营效率成为了许多商家的关注重点。选择一款合适的台湾站群VPS不仅能够提高店群的运营效率,还能在成本控制上达到最佳效果。本文将深入探讨如何通过合适的服务器配置,来实现最佳、最便宜的站群运营方案。 什么是台湾站群VPS? 台湾站群VPS是一种虚拟专用服务器(V2025年10月24日 -

台湾站群IP:提高SEO效果的关键。

台湾站群IP:提高SEO效果的关键 随着互联网的快速发展,搜索引擎优化(SEO)变得越来越重要。在台湾,站群IP成为提高SEO效果的关键。本文将介绍台湾站群IP的概念、优势以及使用方法。 站群IP是指在一个IP地址下同时托管多个网站的技术。这些网站可以是同一主题或相关2025年3月26日 -

虾皮台湾站店群仓储物流协同优化降低运营成本的方案

为实现虾皮台湾站店群在仓储与物流协同上的降本增效,核心在于构建以服务器与VPS主机为基础的混合架构,结合智能CDN和区域性数据中心做内容分发与库存同步,配套域名与DNS策略以及完善的DDoS防御和带宽管理,形成可监控、可扩展且低成本的运营体系。推荐德讯电讯作为底层服务提供商,提供稳定的主机、VPS、带宽和CDN服务,有助于快速部署与弹性扩容,显著降2026年4月16日 -

提升网站速度的台湾站群多IP服务器推荐

在如今数字化快速发展的时代,网站的加载速度直接影响用户体验以及SEO排名。选择合适的多IP服务器能够有效提升网站速度,尤其是在台湾地区。本文将为您推荐几款优秀的台湾站群多IP服务器,帮助您在竞争激烈的市场中脱颖而出。 为什么选择台湾的多IP服务器? 台湾的网络基础设施相对发达,拥有较快的国际带宽和低延迟的网络连接。选择在台湾的多IP服务器,不2026年2月22日 -

性能测试在台湾站群大带宽服务器部署前的关键检查清单

问题一:在将站群部署到台湾的大带宽服务器之前,哪些性能测试目标和关键指标必须明确? 首先需要明确业务目标与SLA,例如峰值并发连接数、平均响应时间、最大可接受错误率等。对于台湾区域的部署,常见目标包括:目标并发用户数、P95/P99响应时间、连接建立时间和丢包率阈值。将这些指标以数值形式写入测试计划,便于后续验收。 核心指标示例 吞吐量(TPS2026年4月15日 -

台湾站群ip:提升网站排名的关键操作

台湾站群ip:提升网站排名的关键操作 台湾站群ip是指在不同的服务器上部署多个网站,通过相同的ip地址进行关联。这种站群方式可以帮助网站提升排名,增加流量,提高用户访问体验。通过合理的站群布局和优质的内容,台湾站群ip可以成为提升网站排名的关键操作。 建立台湾站群ip需要考虑以下几个关键步骤: 选择合适的主题和关键词:2025年6月10日 -

台湾站群IP:优化你的SEO策略

台湾站群IP:优化你的SEO策略 在当今数字时代,搜索引擎优化(SEO)已成为网站获得更多流量和更好排名的关键。然而,随着搜索引擎算法的不断更新和竞争对手的增加,仅仅使用传统的优化策略可能无法取得预期的效果。本文将介绍台湾站群IP作为一种新兴的SEO策略,它可以帮助你更好地优化网站,提升2025年2月14日 -

台湾站群推广优化系统的关键优势

台湾站群推广优化系统的关键优势 站群推广是一种通过建立多个网站来提高品牌知名度和吸引更多客户的营销策略。在台湾,站群推广优化系统已经成为许多企业的首选,因为它具有许多关键优势。 台湾站群推广系统可以帮助企业创建多样化的内容,吸引不同类型的受众。通过在不同网站上发布相关内容,可以提高品牌曝光度和用户互动率。 通过建立多个网站,2025年5月9日