台湾站群监控体系搭建实时发现异常与快速修复流程

在搭建台湾站群监控体系时,工程团队通常在“最好、最佳、最便宜”之间权衡:最好是企业级可扩展方案(如商业APM+SRE支持),最佳常常是性价比最高的开源组合(如Prometheus+Grafana+Alertmanager),而最便宜则是使用轻量级工具(如Zabbix或Netdata)加脚本告警。本文聚焦于服务器监控角度,提供面向站群的实时异常发现与快速修复流程。

一个稳健的台湾站群监控体系包含:数据采集层(Node Exporter、Filebeat、Metricbeat)、指标与日志存储(Prometheus、Elasticsearch)、可视化与告警(Grafana、Alertmanager)、以及自动化修复与工单平台(Ansible、Runbook、Jira/Slack集成)。此架构兼顾实时性、持久化和可扩展性,适配多台位于台湾或混合云的服务器。

在每台服务器上部署agent(如Node Exporter、Telegraf)收集CPU、内存、磁盘、网络、进程等指标;同时配置主动健康检查(HTTP/TCP、SYN/ICMP)和合成事务监控,确保从用户路径层面能实时捕获异常。

选择Prometheus作为时序指标库,配合Thanos或Cortex实现跨地域长周期存储;日志使用ELK/EFK堆栈聚合与检索。对站群场景要分层命名空间、标注实例来源(台湾A机房/台湾B机房)以便定位。

告警应分为阈值告警与异常检测两类。阈值适用于资源饱和场景,异常检测(基于统计或ML)用于捕捉突发性能退化。引入告警抑制、抖动窗口、重复抑制和分级告警策略,避免告警风暴与误报。

建立标准化的快速修复流程:1) 自动化预处理(重启服务、回滚流量);2) 告警推送与上下文(包含最近日志、堆栈、指标图);3) 若自动化失败,触发人工接手并执行Runbook;4) 事后根因分析与SOP更新。

自动化修复以幂等脚本为主(Ansible、SaltStack、Shell),结合容器/服务重启、路由切换、负载均衡下线、DNS故障转移等动作。所有自动化步骤必须可回滚并记录审计日志,降低修复风险。

站群需考虑多AZ/多机房冗余。针对台湾市场,建议在至少两个不同网络段或机房部署备份节点,结合全球/区域DNS负载均衡与健康探测,实现服务切换与零宕机演练。

集成PagerDuty/Slack/LINE/Twilio实现多渠道告警。设定明确的SLA、响应等级与轮班制度。告警工单应自动生成并附带必要上下文,缩短从发现到修复的平均处理时间(MTTR)。

故障后通过指标关联、分布式追踪(Jaeger/Zipkin)和日志检索定位根因。结合时序和链路数据可以快速定位是应用、数据库、网络还是I/O导致问题,并据此优化监控覆盖。

对于预算有限的站群,优先考虑开源堆栈(Prometheus+Grafana+ELK/Fluentd),并在关键路径加上商业SaaS监控作为备份。中小型团队可将“最好”和“最便宜”结合为“最佳”:核心指标自建,外部合约保障重大事件响应。

定期开展故障演练(Chaos Engineering)、告警演练与Runbook复盘,修订SOP与自动化脚本。通过KPI(MTTR、MTTA、告警准确率)驱动监控体系持续优化,确保实时发现异常并实现快速修复流程的闭环。

为台湾站群构建可行的监控体系,需要在采集、存储、告警、自动化修复与运维流程之间找到平衡。采用开源为主、关键路径商业备援的策略,结合规范化的修复流程和演练,可以在成本可控的前提下实现高可用与快速响应,保障站群在台湾市场的稳定运营。

-

周群微博台湾站的运营方法与推广经验分享

周群微博台湾站的运营方法与推广经验分享 在当今的社交媒体时代,微博作为一个重要的平台,其运营与推广策略对于个人或品牌的成功至关重要。本文将深入探讨周群微博台湾站的运营方法与推广经验,分享一些实用的技巧与策略,帮助你在这个竞争激烈的环境中脱颖而出。 以下是我们总结出的三大精华: 精准定位目标受众 内容优先,增强互动性2026年2月19日 -

加入shopee交流微信群获取台湾站最新动态与资源

在当今的电商环境中,及时获取最新动态与资源是每位卖家成功的关键。特别是在台湾站,Shopee作为一个快速发展的电商平台,吸引了大量的卖家和消费者。为了帮助大家更好地理解和把握市场动态,加入shopee交流微信群成为了一种有效的解决方案。 通过加入shopee交流微信群,您将能够实时获取台湾站的最新动态,包括平台政策、流量趋势、市场热点等信息。2025年10月26日 -

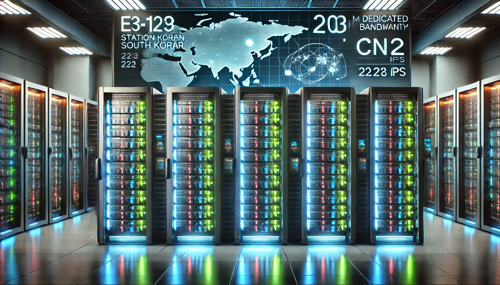

台湾站群云主机:高效稳定的选择

台湾站群云主机是一种提供高效稳定性的网络服务,适用于站群管理的需求。站群是指同时管理多个网站的技术,通过台湾站群云主机可以轻松管理多个网站的运营和维护。 台湾站群云主机具有以下几个优势: 高性能:台湾站群云主机采用先进的硬件设备和优化的网络架构,能够提供卓越的性能表现,确保网站快速加载。 稳定可靠:台湾站群云主机采用分布2025年1月26日 -

台湾站群多IP服务器:提升SEO效果的选择

台湾站群多IP服务器:提升SEO效果的选择 在当今互联网竞争激烈的环境中,网站的SEO(搜索引擎优化)效果对于吸引流量和提升曝光度至关重要。而台湾站群多IP服务器则成为了提升SEO效果的一种选择。 台湾站群多IP服务器是指在台湾地区拥有多个IP地址的服务器。传统的服务器只有一个IP地址,而台湾站群多IP服务器2025年3月29日 -

深入分析虾皮台湾站的客户群特征与行为

1. 引言 随着电子商务的迅猛发展,虾皮台湾站在本地市场中占据了重要地位。深入分析其客户群特征与行为,不仅能帮助商家更好地理解消费者需求,还能为后续的技术支持和服务器配置提供指导。 2. 客户群特征概述 根据市场调研,虾皮台湾站的客户主要可以分为三个特征群体: 年轻消费者:年龄在2026年1月22日 -

台湾站群:实现网站多重曝光的有效策略

台湾站群:实现网站多重曝光的有效策略 台湾站群是一种SEO(搜索引擎优化)策略,通过创建多个相关主题的网站,来提高整体曝光度。这些网站通常由同一团队管理,以确保内容和链接的一致性。 1. 提高曝光度:通过拥有多个网站,可以在搜索引擎结果页面(SERP)中占据更多的位置2025年4月9日 -

台湾站群:提升网站排名的最佳策略

台湾站群:提升网站排名的最佳策略 台湾站群是一种通过建立多个关联网站来提升主要网站排名的策略。这些关联网站通常具有相似的主题和内容,通过相互链接来增加流量和权威性。 台湾站群有以下几个优势: 增加网站流量:通过建立多个关联网站,可以吸引更多的访问者,并将流2025年2月24日 -

台湾UP主在B站形成群体

台湾UP主在B站形成群体 近年来,Bilibili(简称B站)作为中国最大的二次元弹幕视频网站,吸引了大量来自台湾的UP主。这些来自台湾的UP主在B站形成了一个独特的群体,他们通过分享自己的创作内容,促进了两岸文化交流与共享。 随着B站在台湾的知名度日益提高,越来越多的台湾UP主开始加入这个平台,展示自己的才华与创作。他们通过2025年3月26日 -

B站台湾UP主群体的精彩内容

B站台湾UP主群体的精彩内容 随着B站在台湾的知名度逐渐提升,越来越多台湾UP主开始在B站上分享自己的创作。他们以独特的视角和风格,吸引了大量粉丝关注。台湾UP主们的视频内容涵盖了各种领域,包括美食、旅行、美妆、游戏、音乐等,为B站平台增添了许多精彩的内容。 台湾UP主们在B站上的独特魅力主要体现在他们对台湾文化的深刻理解2025年5月20日